下面对自监督学习的方法进行简单的介绍,主要包括:

- 基于前置任务

- 基于对比学习

- 基于掩码重建

其中前置任务又可细分为如下几种子任务:

- 位置预测,包括相对位置及拼图排序

- 旋转预测

- 图片上色,对灰度图片经过卷积层后对每个像素进行颜色填充

- 聚类预测,通过聚类对图片进行分类给出伪标签

而对比学习是通过创建一对pair样本,让正样本之间的距离尽可能地近,而负样本之间的距离尽可能地远。

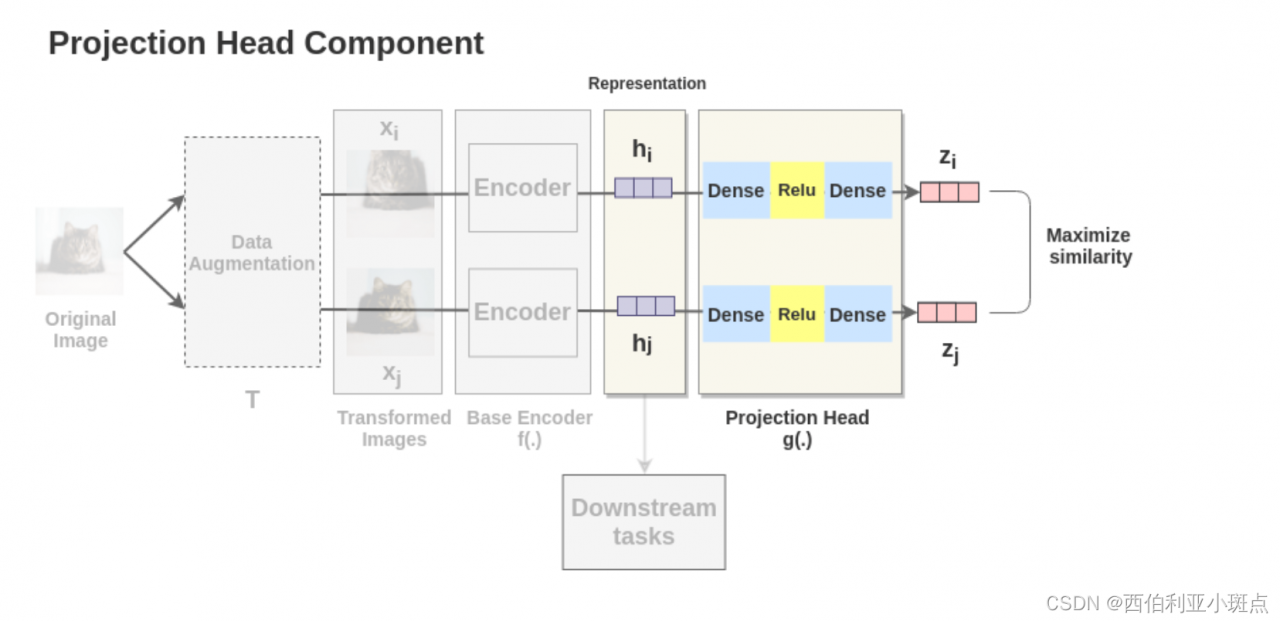

对于一张图像经过数据增强后可以得到两种数据增强后的正样本图像,经过网络后进行特征提取,此时可以通过1个loss让其尽可能小。但是一般情况是连接MLP网络后再添加loss从而得到更好的效果,这就是SimCLR的简化版本。

对于SimCLR的网络结构可以参考下图:

对比学习的另一种方式是MoCo(Momentum Contrast)模型。其中只有1个正样本与查询向量是正相关的,而其他负样本组成的队列与之不相关。这就是第1个版本,而在MoCo V2版本中,采用了更多的数据增强及将SimCLR中的映射层添加了进来,到了V3版本,则转向基于ViT架构并采用双向的对比loss,同时取消内存银行(Memory bank)而采用更大的batch。

而掩码重建则是源自BERT的引申的BEiT模型,通过掩码的方式学习到上下文特征。

基于对比学习的大模型主要是DINO,而基于掩码重建的大模型是MAE。

参考视频:

https://www.bilibili.com/video/BV1hwLEzZEnS https://www.bilibili.com/video/BV1hwLEzZEnS&page=8

如果喜欢这篇文章或对您有帮助,可以:[☕] 请我喝杯咖啡 | [💓] 小额赞助